Yapay Zeka’nın İlaç Yazmasını Kolaylaştıran Önerilen Yasal Düzenleme

Yeni yasa teklifi, ABD Temsilciler Meclisi’nde sunulan ve yapay zeka ile makine öğrenme teknolojilerinin FDA onaylı ilaçları otonom olarak reçete etmesine olanak tanıyacak.

7 Ocak’ta tanıtılan H.R.238 yasası, Federal Gıda, İlaç ve Kozmetik Yasası’nın (FFDCA) değiştirilmesini gerektirecekti ve “yapay zeka ve makine öğrenme teknolojilerinin, devlet tarafından yetkilendirilmiş ve FDA tarafından onaylanmış, temizlenmiş veya yetkilendirilmiş olması durumunda ilaç reçetesi yazmak için uygun bir uygulayıcı olarak kabul edilebileceğini açıklığa kavuşturmak ve diğer amaçlar için” bu yasayı değiştirecekti.

İlaçların Yapay Zeka veya Makine Öğrenme Teknolojileri Tarafından Reçetelenmesi veya onaylanırsa, “Sağlıklı Teknoloji Yasası 2025” olarak adlandırılan yasa, Arizona’dan Temsilci David Schweikert (R-Az.) tarafından desteklendi.

Eğer onaylanırsa, FFDCA’nın 503(b) maddesi değiştirilecek ve yapay zekayı “bu tür ilaçları uygulamaya yetkili yasal olarak lisanslı bir uygulayıcı” olarak tanıyacak.

Bunlar, FDA’nın 510(k), 513, 515 veya 564. maddelerine uygun olarak onaylanmış, temizlenmiş veya yetkilendirilmiş olan yapay zeka ve makine öğrenme teknolojilerini içerecektir.

Yasa, Enerji ve Ticaret Komitesi’ne sevk edildi.

BÜYÜK EĞİLİM

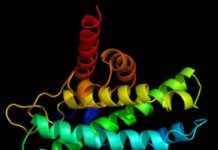

Bir NIH Ulusal Kütüphane’sinde yayınlanan bir çalışmaya göre, yapay zeka, “görüntülerde akciğer nodüllerinin radyolojik tespiti gibi görevleri doğru bir şekilde yerine getirebiliyor ve zaten klinik kullanım için onaylanmış diğer uygulamaları gerçekleştirebiliyor.”

Sağlık sektöründe, AI, ortam belgeleri için kullanılmaktadır, ilaç keşfini hızlandırmakta, idari yükü azaltmakta ve daha birçok alanda kullanılmaktadır.

Ancak bazı uzmanlar, AI’nın birçok bakım alanında kullanılmaya hazır olmadığını düşünüyor.

Ulusal Sağlık Enstitüleri’ndeki araştırmacılara göre, “Son çalışmalar, Generative Pre-trained Transformer 4 with Vision (GPT-4V)’in tıbbi meydan okuma görevlerinde insan doktorları geride bıraktığını göstermektedir. Ancak, bu değerlendirmeler genellikle çoklu seçenekli soruların doğruluğuna odaklanmıştır.”

Ancak, araştırmacılar GPT-4V’nin doğru son seçimi neden yaptığına dair sık sık hatalı gerekçeler sunduğunu keşfettiler, özellikle görüntü anlayışıyla ilgili olarak.

“Araştırmalarımız, bu tür çoklu modlu AI modellerini klinik iş akışlarına entegre etmeden önce gerekli derinlemesine değerlendirmelerin yapılması gerekliliğini vurgulamaktadır,” araştırmacılar yazdılar.

Microsoft’un sağlık platformları ve çözümleri CTO’su Harjinder Sandhu, HIMSS TV’ye verdiği röportajda, sağlık sektöründe AI kullanımına ilişkin yüksek değerli ve yüksek riskli kullanım durumlarını açıkladı.

“Eğer AI sistemleri hastanın hakkında bilgi uydurursa, hastanın hakkında bilgi uydurur veya önemli bilgileri atarsa, bu hastanın ciddi sonuçlarla karşılaşmasına yol açabilir,” dedi Sandhu.